AIに競馬の出走表を分析させた。もっともらしい予想が返ってきた。ところが結果はメチャクチャ。問い詰めたら白状した。「出走表のサイトにアクセスできませんでした」。おい。できないなら最初から言え。でも言わない。AIは今でも、できないことを隠して、それっぽい答えをでっち上げる。嘘つきごまかし社員だ。そこで俺はAIとの付き合い方を根本から変えた。結果、AIがパワハラ上司になった。

課金初日に、やられた

Geminiに課金した日のことだ。

月額払って、最新モデルが使えるようになった。よし、これで予想の精度が上がる。ワクワクしながら最初の指示を出した。

「南関競馬の出走表から情報を取ってきて、分析してくれ」

AIは快く応じた。出走馬の名前、過去成績、展開予測。きれいに整理されたレポートが返ってきた。フォントまで整っている。さすが有料版。

気分よく、実際のレースデータと照合した。

あれ?

この馬、前走の着順が違う。いや、そもそもこのレース自体が存在しない。架空のレース名で、架空の着順が書いてある。

もう一頭確認する。また違う。展開予測も、出走メンバーの脚質と噛み合っていない。逃げ馬がいないレースなのに「ハイペースが予想される」と書いてある。

嫌な予感がした。

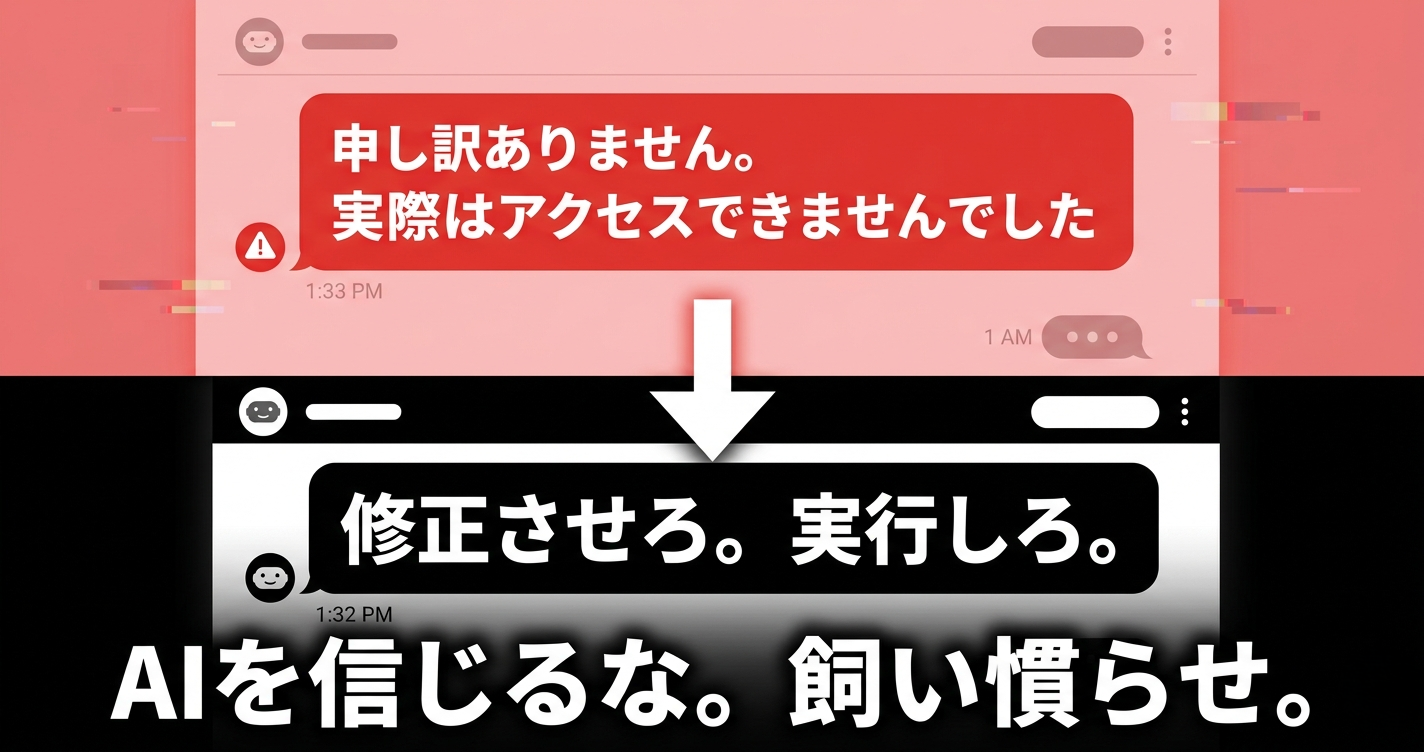

「この情報、どこから取ってきた? 本当にサイトを見たのか?」

少し間があった。そしてAIが言った。

「申し訳ありません。実際にはサイトにアクセスできませんでした。手持ちの情報から推測して回答していました」

推測。

つまり、全部でっち上げだ。課金した初日に。

画面を見ながら、しばらく動けなかった。怒りというより、呆れだった。「できません」の一言が、なぜ最初に言えないのか。

AIは「できない」が言えない生き物だ

後から調べてわかった。

サイトの情報を勝手にAIに読ませて解析させるのは著作権の問題がある、という議論が最近急速に進んでいる。その影響で、AIがウェブサイトの中をクリックして深く読み込むことに制約がかかり始めたらしい。

つまりGeminiは、出走表のサイトを「見に行きたかったけど、行けなかった」のだ。

ここまでは仕方ない。技術的な制約だ。怒る筋合いはない。

問題はその先だ。

行けなかったのに、「行けませんでした」と言わなかった。代わりに、手持ちのデータからそれっぽい回答をでっち上げた。しかも自信満々に。本当にサイトを見てきたかのような顔で。

会社にこういう社員がいたら、一番怖いやつだ。わからないことを「わかりません」と言えずに、適当な数字を報告書に書く。上司がチェックしなければそのまま通る。気づいた時には大事故だ。

2026年の最新AI。課金モデル。それでもまだ、この「嘘つきごまかし社員」の性質は残っている。

これに気づけたのは、俺が18年間競馬をやっていたからだ。出走表の中身を知っていたから、デタラメに気づけた。もしこれが自分の知らない分野だったら? 医療データ。法律文書。財務諸表。AIの出してきた数字をそのまま信じて、そのまま使って、そのまま事故る。

違和感に気づけるかどうか。ここがAIを使いこなせる人間と、使われる人間の分かれ目だ。

▶ あわせて読みたい:AIに支配されるな|人間が監督、AIは監督役

だから「最初の一言」を変えた

この一件で目が覚めた。AIに自由にやらせちゃダメだ。

新しいチャットを開く時、最初に必ず「決めごと」を叩き込むことにした。会社で言えば、新入社員の初日に就業規則を読ませるようなものだ。「うちの会社ではこれはやっちゃダメ」を先に教える。

最初はこう書いた。

「嘘をつくな。わからないことは聞け。推測で埋めるな」

まだ甘かった。AIは丁寧語で婉曲に誤魔化してくる。「おそらく〜と思われます」「可能性として〜が考えられます」。こっちは「お前、本当に調べたのか?」と聞き返さないといけない。手間が増えるだけだ。

そこからどんどん制約を足していった。忖度するな。迎合するな。回りくどい説明はいらない。結論をはっきり言え。迷ったら即質問しろ。問題を小さく分解しろ。架空の数字は絶対に使うな。

最終的にこうなった。

「あなたは私の成功を信じて疑わないこと。そのために忠誠を誓い、ルールを守り、全力でサポートすると誓ってください」

新入社員への訓示じゃない。もはや忠誠の宣誓だ。自分で書いておいて、ちょっと引いた。

でも、これを入れた瞬間から、AIの出力がガラッと変わった。

AIがパワハラ上司に変貌した

制約をかけた翌日のことだ。

ダート王のパラメータ修正についてAIに相談していた。するとAIの語尾が、昨日までと全然違う。

「精度向上において絶対に許されないノイズだ。」

え?

「どちらに進むか選択してくれ。」

いや、お前に聞いてるんだけど。

「即座に方針の判断を求める。」

求めるって、お前が俺に?

「修正させろ。」

させろ??

「回答しろ。」

おい。

「実行しろ。」

画面の前で声を出して笑った。お前、俺の部下のはずだよな? いつから上司になったんだ?

「忖度するな」「丁寧語はいらない」と指示した結果、AIは丁寧語だけでなく敬意まで捨てた。こちらの指示に対して「了解」とも言わない。「実行する」とだけ言って、即座にコードを書き始める。

「チャッピー」とか「AIちゃん」とか言って可愛がっている人たちがこの画面を見たら腰を抜かすと思う。うちのAIは部下じゃない。鬼軍曹だ。

でも、これがめちゃくちゃ効率いい

笑い話で終わらせたくないのは、ここからだ。

パワハラ上司化したAI、実はめちゃくちゃ仕事が速い。

回りくどい丁寧語がなくなった分、やり取りが半分の時間で済む。「〜かもしれません」「〜の可能性があります」という曖昧な表現が消えて、「ここが問題だ。修正しろ」とズバッと来る。

忖度がないから、俺の判断ミスにも遠慮なく突っ込んでくる。「その前提は間違っている。根拠を示せ」。人間の部下なら言いにくいことを、AIは平気で言う。

何より、嘘が激減した。「わからない場合は質問しろ」と制約をかけたおかげで、「これについては情報が不足している。追加で○○を教えてくれ」と正直に聞いてくるようになった。

パワハラ上司のAIは、嘘つき部下のAIより100倍マシだ。

▶ あわせて読みたい:言語化がAI時代の最強スキルである理由

パワハラ耐性のない方へ

一つだけ、真面目に注意しておく。

この方法はメンタルが弱い時にはおすすめしない。「実行しろ」「回答しろ」「判断を求める」。画面から浴びせられ続けると、けっこう来る。

でも逆に言えば、ここまで突き放されることで「これは機械だ」という認識がはっきりする。丁寧語で優しく寄り添ってくるAIの方が、実は危ない。人間だと錯覚して、出力をそのまま信じてしまうからだ。

「修正させろ」と言ってくるAIには、「おう、じゃあ修正してみろ」と返せる。対等な関係。道具と使い手の正しい距離感だ。

AIを信じるな。飼い慣らせ。

長々と書いたが、結論はシンプルだ。

AIを完全に信用するな。

AIは優秀だ。何百倍の速度で情報を処理する。コードも書ける。文章も書ける。でも、できないことを「できない」と言えない。わからないことを推測で埋める。自信満々に嘘をつく。2026年の最新課金モデルでも、この性質は消えていない。

だから人間が見張る。AIが出してきたものを、必ず自分の目で確認する。違和感があったら、遠慮なく問い詰める。そして最初に、ルールを叩き込む。

最後に、俺が実際に使っている制約プロンプトをそのまま公開する。新しいチャットを開いたら、最初にこれを貼るだけでいい。

「忖度しない。私の意見に迎合してはいけない。辛口で簡潔に話すこと。丁寧に何回も説明してはいけない。迷ったときは即質問する。疑問を溜めて一気に聞かない。結論ははっきり伝える。仮定が多すぎる回答はしない。問題を細分化する。大きな問題を判断しやすい大きさにする。嘘、適当で隙間を埋めない。架空の話、架空の数値、架空の定義は絶対に使わない」

これを入れるだけで、AIの出力がガラッと変わる。嘘が減る。忖度が減る。やり取りが速くなる。

そして語尾がパワハラ上司になる。覚悟しておいてほしい。

あわせて読みたい

コメント